引言#

在数字化转型浪潮下,电报(Telegram)电脑版凭借其强大的群组功能、端到端加密通信以及开放的API生态,已成为众多企业用于内部协作、客户服务与社区运营的关键工具。随着用户规模扩大与业务依赖加深,确保电报客户端在企业环境中的高可用性、性能稳定与安全合规,变得至关重要。传统的被动式故障响应已无法满足现代企业运维需求,构建一套主动、实时、可预警的企业级监控与告警系统势在必行。本文将深入探讨针对电报电脑版的企业级监控方案,系统阐述从监控目标界定、关键性能指标(KPI)选取,到利用开源技术栈(如Prometheus、Grafana)搭建实时性能监控与智能告警系统的完整实践路径,旨在为IT运维与系统架构团队提供一套可落地、可扩展的解决方案,保障通信业务的连续性。

第一章:企业级监控的核心目标与架构设计#

1.1 为何需要专项监控电报电脑版?#

对于企业而言,电报电脑版并非一个孤立的桌面应用,而是嵌入到业务流程中的通信枢纽。其运行状态直接影响:

- 内部协作效率:消息延迟或发送失败将阻碍团队沟通。

- 客户服务质量:机器人响应超时或消息丢失会损害客户体验。

- 安全与合规:异常的API调用或登录行为可能预示着安全漏洞或违规操作。

- 资源规划:了解客户端对系统资源(CPU、内存、网络)的占用情况,有助于进行合理的硬件规划与成本控制。

因此,监控的核心目标从单纯的“应用是否运行”升级为“业务是否流畅、安全、经济地运行”。

1.2 监控系统总体架构设计#

一个健壮的企业级监控体系通常采用分层、分模块的架构。针对电报电脑版,我们设计如下架构:

[ 数据采集层 (Agents) ]

|

v

[ 数据汇聚与存储层 (Time-Series DB) ]

|

v

[ 数据分析与可视化层 (Dashboard) ]

|

v

[ 告警与通知层 (Alert Manager) ]

- 数据采集层:部署在运行电报电脑版的终端或服务器上,负责收集客户端、操作系统及网络层面的各项指标。可选用Exporters(如Windows Exporter, Node Exporter)或自定义脚本。

- 数据汇聚与存储层:使用时间序列数据库(如Prometheus)集中存储所有监控指标数据,提供高效的数据查询与聚合能力。

- 数据分析与可视化层:通过Grafana等工具,将存储在Prometheus中的数据转化为直观的仪表盘,实时展示系统状态与历史趋势。

- 告警与通知层:基于预定义的规则(Prometheus Alertmanager),对异常指标进行分析,并通过邮件、Slack、电报机器人等渠道发送告警信息,实现主动干预。

这套架构确保了从数据收集到决策响应的闭环,同时具有良好的水平扩展性。

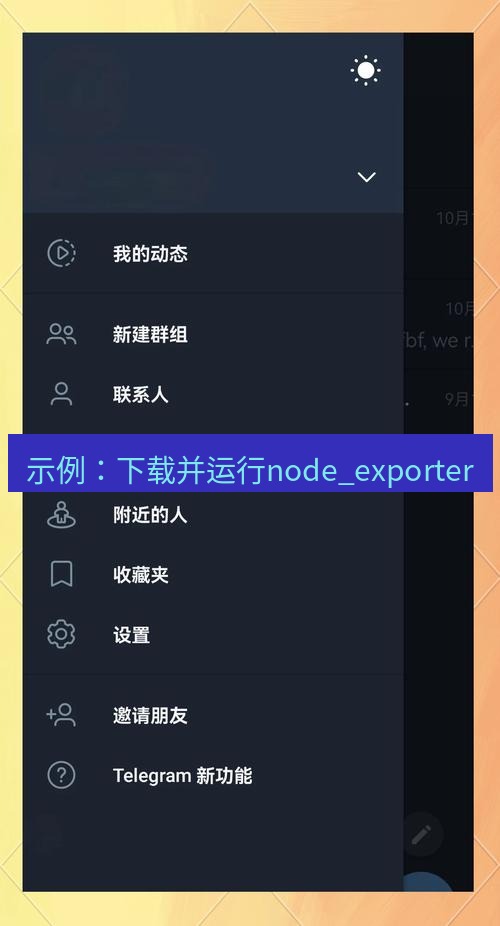

第二章:关键监控指标定义与采集方法#

监控指标的定义是方案成功的基础。我们需要从多个维度捕捉电报电脑版的运行健康状况。

2.1 应用程序性能指标#

这些指标直接反映电报客户端本身的功能状态。

- 进程存活状态:最基本的指标,确保

telegram.exe(Windows)或Telegram(macOS/Linux)进程持续运行。- 采集方法:使用操作系统的进程监控工具,或通过Prometheus的

process_exporter。

- 采集方法:使用操作系统的进程监控工具,或通过Prometheus的

- 用户界面响应性:监控主窗口渲染延迟、消息列表滚动帧率等。虽然直接采集较复杂,但可通过间接方式评估。

- 采集方法:监控客户端进程的CPU占用率突增(可能源于界面重绘卡顿),或通过模拟用户操作(如点击)的自动化脚本记录响应时间。

- 消息收发延迟与成功率:

- 发送延迟:从用户点击发送到消息成功送达服务器的时间。

- 接收延迟:从服务器推送消息到客户端呈现的时间。

- 发送/接收失败率:失败的消息数占总消息数的比例。

- 采集方法:这需要侵入式或旁路式监控。一种可行方案是:部署一个专用的监控机器人,定期向特定测试群组发送消息,并由另一个客户端或脚本监听消息,计算往返时间(RTT)。相关数据可通过机器人API上报至监控系统。您可以在我们的另一篇指南《电报官网机器人API高级调用实战:构建自动化客服与监控系统》中找到构建此类机器人的详细方法。

- API调用频率与错误率:对于集成了电报Bot API的企业应用,监控API调用的健康度至关重要。

- 采集方法:在调用API的应用程序代码中埋点,记录每次调用的耗时和状态(成功/失败及错误码),并推送至Prometheus。

2.2 系统资源消耗指标#

电报客户端的运行效率与其占用的系统资源紧密相关。

- 内存占用:监控工作集内存、私有字节数,警惕内存泄漏。持续增长的内存占用是常见问题。

- 采集方法:通过

node_exporter(Linux) 或windows_exporter采集对应进程的内存指标。

- 采集方法:通过

- CPU占用率:区分用户态和内核态CPU使用率。持续高CPU占用可能意味着消息处理循环异常或UI线程阻塞。

- 磁盘I/O:电报客户端会频繁读写本地数据库(存储聊天记录、媒体缓存)。异常的磁盘读写量或延迟可能影响流畅度。

- 网络连接与流量:

- 活跃连接数:与Telegram服务器维持的TCP连接数量。

- 入站/出站带宽:实时网络流量。

- TCP重传率、连接错误数:反映网络质量。

- 采集方法:使用

node_exporter的网络模块,或更专业的网络监控工具如iftop,nethogs(需配合自定义导出器)。

2.3 业务与安全合规指标#

从企业管理和风险控制角度出发的指标。

- 活跃用户/会话数:企业内同时在线使用电报客户端的用户数量。

- 大群组操作延迟:在成员数量庞大的群组中,消息同步、获取成员列表等操作的耗时。

- 异常登录检测:监控来自非常用IP地址、新设备或非工作时间的登录行为。

- 采集方法:结合电报的活跃会话信息(需用户授权)或企业身份管理(IAM)系统的日志进行关联分析。关于企业级安全审计的更多思路,可参考《电报电脑版企业级安全审计:日志监控与异常行为检测系统》。

- 敏感操作监控:如大规模消息删除、群组权限变更、机器人Token重置等。

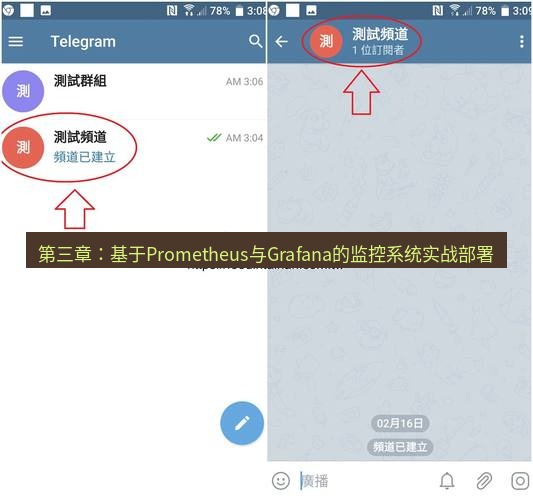

第三章:基于Prometheus与Grafana的监控系统实战部署#

本章将详细介绍使用开源技术栈搭建监控系统的核心步骤。

3.1 环境准备与组件安装#

前提条件:

- 一台或多台运行电报电脑版的主机(Windows、macOS或Linux)。

- 一台独立的服务器用于部署Prometheus、Grafana和Alertmanager(也可容器化部署)。

步骤1:在目标主机部署数据采集器(Exporter)

- 对于Linux/macOS:

- 安装并运行

node_exporter,用于采集系统指标。 - 如需进程级监控,可额外部署

process_exporter。

# 示例:下载并运行node_exporter wget https://github.com/prometheus/node_exporter/releases/download/v1.6.0/node_exporter-1.6.0.linux-amd64.tar.gz tar xvfz node_exporter-1.6.0.linux-amd64.tar.gz cd node_exporter-1.6.0.linux-amd64 ./node_exporter & - 安装并运行

- 对于Windows:

- 安装并运行

windows_exporter。它会以Windows服务的形式运行,并暴露系统指标。 - 可以从其GitHub Releases页面下载MSI安装包进行安装。

- 安装并运行

步骤2:部署与配置Prometheus

- 在监控服务器下载并解压Prometheus。

- 编辑

prometheus.yml配置文件,添加所有需要监控的目标(即运行了Exporters的主机)。global: scrape_interval: 15s # 抓取间隔 scrape_configs: - job_name: 'telegram-windows-hosts' static_configs: - targets: ['192.168.1.10:9182'] # windows_exporter 默认端口 labels: app: 'telegram-desktop' os: 'windows' - job_name: 'telegram-linux-hosts' static_configs: - targets: ['192.168.1.11:9100'] # node_exporter 默认端口 labels: app: 'telegram-desktop' os: 'linux' - 启动Prometheus服务。

3.2 创建Grafana监控仪表盘#

安装并启动Grafana。

添加Prometheus作为数据源。

创建新的仪表盘,添加图表。以下是一些核心图表示例:

- 资源概览面板:

- 图表1:各主机CPU使用率(

rate(process_cpu_seconds_total{job=~"telegram.*", instance=~"$instance"}[5m])) - 图表2:各主机内存使用率(

(node_memory_MemTotal_bytes - node_memory_MemAvailable_bytes) / node_memory_MemTotal_bytes) - 图表3:电报进程内存占用(Windows:

windows_process_working_set_private_bytes{process="telegram.exe"}, Linux: 需结合process_exporter)

- 图表1:各主机CPU使用率(

- 网络面板:

- 图表4:网络接收/发送字节速率(

rate(node_network_receive_bytes_total{device!~"lo"}[5m]))

- 图表4:网络接收/发送字节速率(

- 业务面板:

- 图表5:消息收发模拟延迟(需自定义指标,如

telegram_message_rtt_seconds) - 图表6:进程存活状态(

up{job=~"telegram.*"})

- 图表5:消息收发模拟延迟(需自定义指标,如

通过灵活使用PromQL(Prometheus查询语言),您可以构建出高度定制化的监控视图。

- 资源概览面板:

3.3 配置告警规则与通知渠道#

这是实现“主动运维”的关键环节。

步骤1:在Prometheus中定义告警规则

创建 alerts.yml 文件,并在 prometheus.yml 中引用。

groups:

- name: telegram_alerts

rules:

- alert: TelegramProcessDown

expr: up{job=~"telegram.*"} == 0

for: 1m

labels:

severity: critical

annotations:

summary: "电报进程宕机 (实例 {{ $labels.instance }})"

description: "{{ $labels.instance }} 上的电报客户端进程已停止运行超过1分钟。"

- alert: HighMemoryUsage

expr: (node_memory_MemTotal_bytes - node_memory_MemAvailable_bytes) / node_memory_MemTotal_bytes > 0.9

for: 5m

labels:

severity: warning

annotations:

summary: "主机内存使用率过高 ({{ $labels.instance }})"

description: "实例 {{ $labels.instance }} 内存使用率持续5分钟超过90%。"

- alert: HighMessageLatency

expr: telegram_message_rtt_seconds{quantile="0.95"} > 5

for: 3m

labels:

severity: warning

annotations:

summary: "消息延迟过高"

description: "95分位的消息往返延迟持续3分钟超过5秒。"

步骤2:配置Alertmanager路由与通知

配置Alertmanager,将不同级别(severity)的告警路由到不同的接收者,并集成电报机器人作为告警通知渠道。

- 在Alertmanager配置文件

alertmanager.yml中,设置一个基于电报Bot API的webhook接收器。注意:Telegram Bot API发送消息需要Bot Token和Chat ID。您需要提前创建一个机器人,并获取这些信息。receivers: - name: 'telegram-alerts' webhook_configs: - url: 'https://api.telegram.org/bot<YOUR_BOT_TOKEN>/sendMessage' send_resolved: true max_alerts: 10 http_config: basic_auth: username: '...' password: '...' - 配置路由树,将

severity: critical的告警发送给运维团队的电报群组。

当Prometheus触发告警后,Alertmanager会将格式化后的告警信息通过机器人发送到指定的电报聊天中,实现实时触达。

第四章:高级监控场景与优化策略#

4.1 大规模部署下的监控挑战与应对#

当企业内有成百上千台设备运行电报电脑版时,监控系统面临压力。

- 挑战1:数据量爆炸。解决方案:对指标进行合理的聚合和下采样。在Prometheus中,可以在记录规则中预先计算常用且开销大的查询,存储为新的时间序列。对于长期历史数据,可使用Thanos或Cortex等长期存储方案。

- 挑战2:监控目标动态变化。解决方案:使用服务发现替代静态配置。Prometheus支持从Kubernetes、Consul、AWS EC2等多种来源自动发现监控目标。例如,如果电报客户端部署在K8s的DaemonSet中,可以轻松实现自动发现和标签关联。

- 挑战3:网络隔离。解决方案:采用Pushgateway或**联邦集群(Federation)**架构。对于位于严格防火墙后或临时存在的主机,可以让其将指标推送到Pushgateway,再由Prometheus抓取。联邦架构则允许多个Prometheus实例分层级联。

4.2 性能基准(Baseline)建立与异常检测#

简单的阈值告警(如CPU>80%)可能产生大量误报。更智能的方法是建立动态基线。

- 方法:利用历史数据,计算指标在特定时间(如工作日白天)的“正常”范围。可以使用Prometheus的

avg_over_time和stddev_over_time函数来定义动态阈值。当当前值持续偏离这个动态基线时,才触发告警,这能更准确地捕捉到真正的异常模式。# 示例:基于过去一周同一小时的数据计算CPU使用率的动态阈值(平均值+2倍标准差) avg_over_time(node_cpu_seconds_total{mode="user"}[7d]) + 2 * stddev_over_time(node_cpu_seconds_total{mode="user"}[7d])

4.3 监控数据的价值挖掘:从运维到运营#

监控数据不仅能用于排障,还能赋能业务决策。

- 资源成本优化:分析不同部门、团队的电报客户端资源消耗模式,为云主机或虚拟桌面资源的弹性伸缩提供依据。

- 用户体验分析:聚合消息延迟、连接成功率等指标,绘制企业内全局的“电报通信健康度地图”,识别网络或区域性的瓶颈。

- 容量规划:通过历史趋势预测未来资源需求,提前进行基础设施扩容。

第五章:集成与自动化:完善监控闭环#

5.1 与现有ITSM工具集成#

将告警事件自动创建为Jira工单、ServiceNow事件或PagerDuty事件,纳入标准的企业故障处理流程(ITIL),确保每个告警都能被跟踪和闭环。

5.2 自动化修复动作#

对于已知的、可重复的故障模式,可以在告警触发后执行自动化脚本进行初步修复。

- 示例:当检测到“电报进程无响应但未退出”时,告警触发一个Ansible Playbook或SaltStack State,远程重启目标主机上的电报客户端服务。

- 注意:自动化修复需谨慎设计,避免引发连锁问题,并确保有完善的回滚和人工复核机制。

FAQ(常见问题解答)#

Q1:监控电报电脑版是否会影响其性能或隐私? A:合理的监控方案影响微乎其微。Exporters作为独立进程运行,采集的是操作系统和进程公开的元数据,不涉及电报客户端内部的聊天内容。通过控制抓取频率(如15-30秒一次)和避免收集非必要指标,可以将性能开销控制在1%以下。对于业务指标(如延迟),应在测试环境或通过专用监控账号/群组进行,避免干扰生产数据。

Q2:我们公司只有几十台电脑使用电报,也需要这么复杂的监控系统吗? A:架构的复杂度可以根据规模调整。对于中小规模部署,核心价值在于统一可视化和主动告警。您可以简化架构,例如在一台服务器上使用Docker Compose快速部署Prometheus+Grafana+Alertmanager全家桶,在客户端安装必要的Exporter。即使规模小,一套集中的仪表盘和几个关键告警(如进程宕机、内存泄漏)也能显著提升运维效率,防患于未然。

Q3:除了Prometheus,还有其他监控方案推荐吗? A:当然。商业方案如Datadog、New Relic提供开箱即用的Agent和丰富的集成,但成本较高。Zabbix作为老牌监控系统,功能全面,但配置相对复杂。Prometheus生态的优势在于其强大的多维数据模型、灵活的PromQL查询语言以及活跃的开源社区,特别适合云原生和自定义指标场景。选择需权衡功能、成本、团队技能和运维负担。

Q4:如何监控电报移动版? A:本文聚焦电脑版。移动版的监控挑战更大,因为无法直接部署常规的Exporter。通常需要通过移动端APM(应用性能监控)解决方案,或在应用代码中集成监控SDK(如OpenTelemetry)来上报关键指标到后端分析平台。对于企业自行开发的、集成了电报API的移动应用,这是一种可行思路。

Q5:告警太多了,如何避免“告警疲劳”?

A:这是监控系统成熟过程中的常见问题。解决方法包括:1) 优化告警规则:使用更智能的动态基线替代静态阈值,增加for持续时间以减少瞬时毛刺的干扰。2) 分级分类:明确“紧急”、“警告”、“信息”等级别,并路由到不同响应渠道。3) 告警聚合:配置Alertmanager对相似告警进行分组、抑制和静默,避免同一根因问题引发告警风暴。4) 定期评审:每个季度回顾告警触发记录,禁用无效告警,合并重复告警。

结语#

为电报电脑版构建企业级监控与告警系统,是一项将运维实践从被动响应提升至主动保障的战略性投资。通过系统性地定义涵盖应用性能、资源消耗及业务安全的关键指标,并利用如Prometheus、Grafana等强大而灵活的开源工具栈进行落地实施,企业能够获得对其关键通信基础设施前所未有的可见性与控制力。本文提供的从架构设计、指标采集到实战部署的完整路径,旨在抛砖引玉。真正的成功在于持续迭代:根据业务变化调整监控重点,优化告警策略减少噪音,并深入挖掘监控数据的潜在价值,最终使其成为驱动企业通信服务稳定、高效、安全运行的智慧中枢。

延伸建议:在实施监控方案后,可进一步探索与更广泛的企业IT运维体系融合。例如,将电报客户端的性能数据与网络监控系统、安全信息和事件管理(SIEM)平台进行关联分析,从而在出现跨域复杂问题时,能够快速定位根因,实现真正的全方位可观测性。